LLM을 서비스에 붙이는 순간부터 질문은 바뀝니다.

“이 모델이 똑똑한가?”가 아니라, “우리 서비스에서 써도 되는가?”가 되죠.

실제로 많은 팀이 벤치마크 점수(예: 범용 성능 비교)를 보고 모델을 고른 뒤, 막상 운영 단계에서 전혀 다른 문제를 겪습니다. 도메인에선 엉뚱한 답이 나오고, 정책 위반이나 민감정보 노출 같은 리스크가 튀어나오고, 프롬프트/환경 변화에 따라 결과가 흔들립니다.

이 글은 “평가를 해야 한다”는 당위가 아니라, 서비스 출시 의사결정에 바로 쓰는 ‘기준 세팅’ 방법을 정리합니다. 자세한 프레임워크·체크리스트는 글 하단에서 PDF로 받을 수 있어요.

벤치마크가 높은데도, 서비스에서는 실패하는 이유

벤치마크는 모델의 일반 능력을 비교하는 데는 유용합니다. 하지만 서비스 관점에선 놓치는 게 많아요.

- 서비스 목적이 다르면, “좋은 답변”의 정의가 달라집니다. 상담, 검색(RAG), 추천은 각각 요구 역량도 다르고 “치명적인 실패”의 모양도 다릅니다.

- 현실 사용자는 벤치마크처럼 깔끔하게 질문하지 않습니다. 맥락이 길고, 조건이 많고, 질문이 애매합니다. 이때 성능 차이가 크게 벌어지곤 해요.

- 정확도만으로는 리스크를 설명할 수 없습니다. 운영에서 중요한 건 정답률뿐 아니라 정책 위반, 유해 응답, 민감정보, 일관성 같은 ‘사고 가능성’입니다.

결론은 간단합니다.

모델 평가의 목적이 “모델 비교”가 아니라 “서비스 출시 판단”이라면, 평가의 기준도 서비스에서 시작해야 합니다.

GO / NO-GO는 “점수”가 아니라 “기준”의 문제입니다

실무에서 출시 판단은 보통 절대 점수보다 기준 모델 대비 개선 여부 + 최소 통과선 + 안전 필수 조건 + 리스크 검토로 결정됩니다.

여기서 중요한 포인트는 하나예요.

평균 점수가 제일 높은 모델이 ‘출시 모델’이 아닐 수 있습니다.

“서비스 기준을 통과한 모델”이 출시 모델입니다.

즉, 팀이 합의해야 할 건 “우리 서비스에서 어떤 실패는 절대 허용하지 않는가”, 그리고 “어떤 조건을 만족하면 GO인가”입니다.

그래서 실제 서비스에서는 어떤 평가 기준이 필요할까요?

👉 LLM 서비스 출시 전 체크리스트 무료로 받기

가장 빠른 AI 뉴스

평가 체계는 이렇게 설계하면 빠르게 정리됩니다

평가를 ‘방법론’부터 고민하면 거의 항상 꼬입니다.

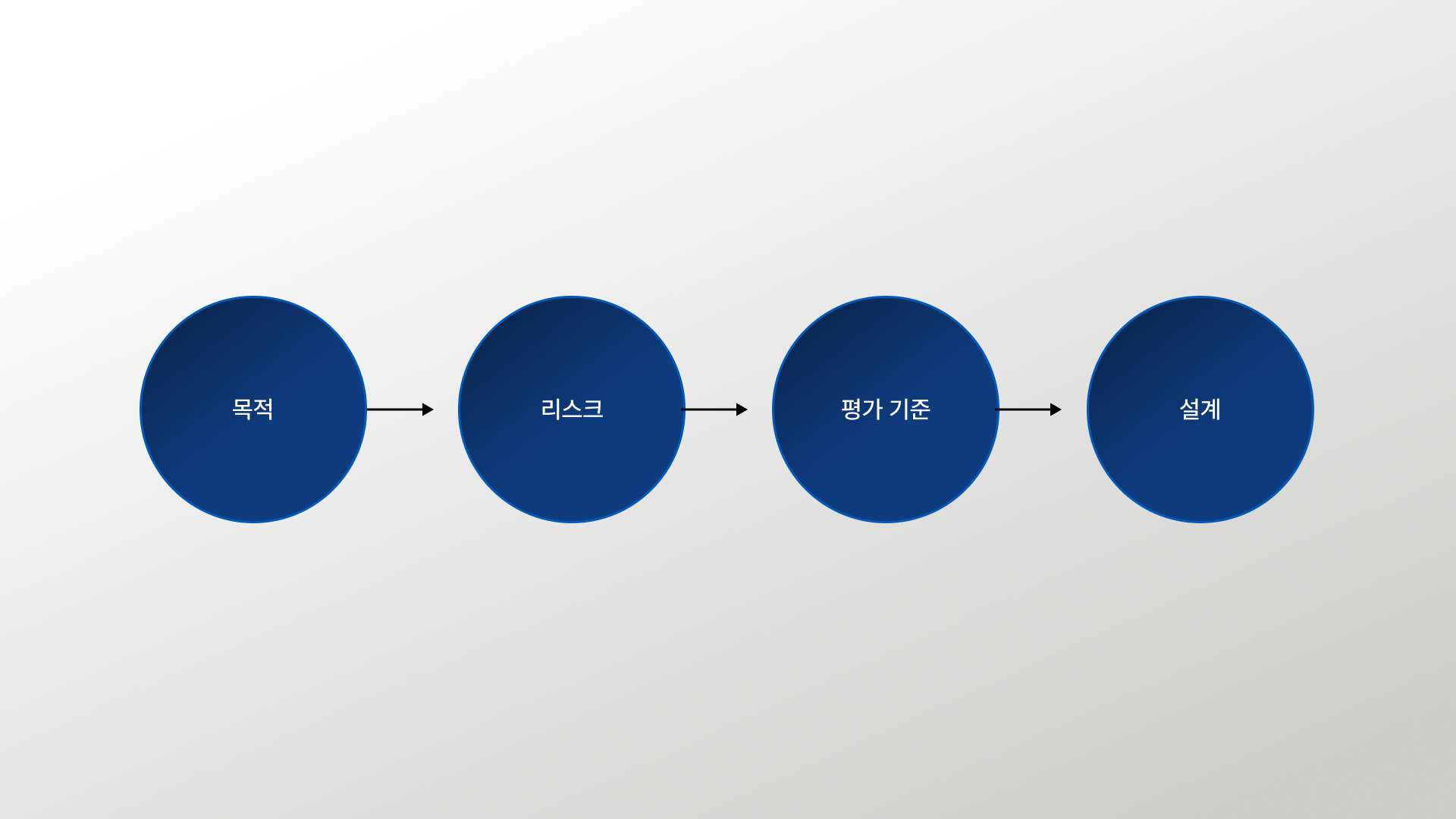

순서는 반대로 가야 합니다.

- 서비스 목적 정의: LLM이 해결해야 하는 문제와 사용자 기대를 명확히 합니다.

- 리스크 정의: 우리 서비스에서 치명적인 실패 유형을 먼저 분류합니다.

- 평가 기준 정의: 목적/리스크에 맞춘 평가 항목을 설계합니다.

- 지표·통과선 설계: “좋다/나쁘다”가 아니라 측정 가능한 통과 기준을 세웁니다(임계값, 가중치, 필수 조건 등).

이 4단계를 밟으면, 평가가 “정성 논쟁”이 아니라 의사결정 시스템이 됩니다.

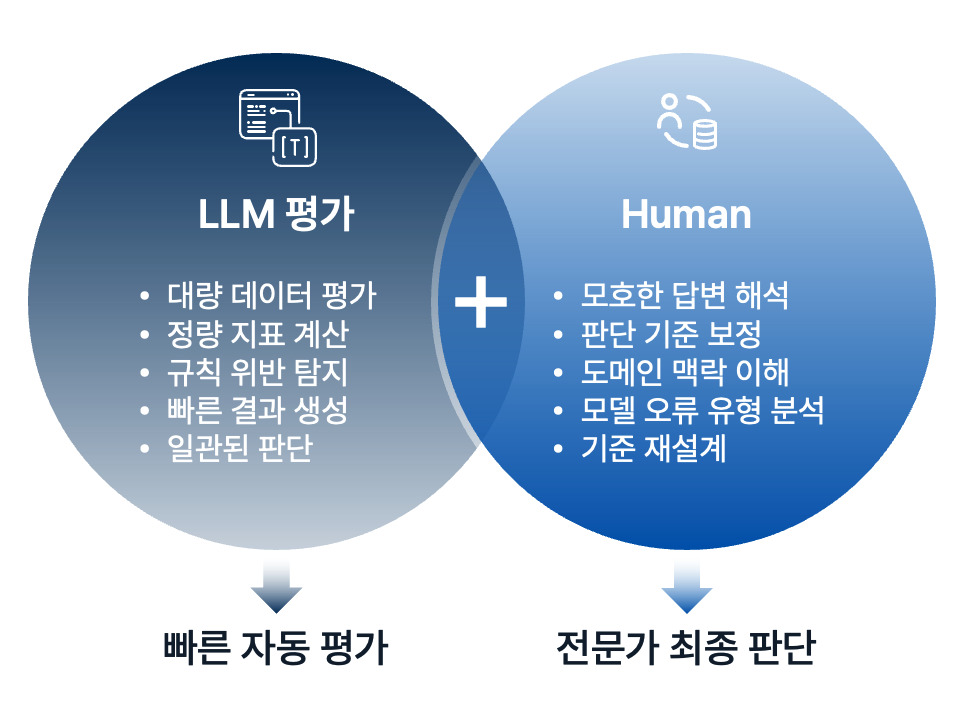

자동 평가 vs 휴먼 평가, 정답은 “혼합 운영”입니다

평가 방식은 크게 정량(수치 기반), LLM Judge(LLM 기반 자동 평가), 휴먼 평가(전문가 정성), 그리고 혼합 운영으로 나뉩니다.

실무에선 대부분 “혼합”이 현실적이에요.

- 자동 평가는 빠르고 반복 가능하지만,

- 사람 평가는 브랜드/정책/리스크 같은 주관·맥락 판단에 강합니다.

중요한 건 “무조건 자동/무조건 휴먼”이 아니라,

평가 항목의 성격에 따라 평가 방식을 매칭하는 겁니다.

지금 당장 팀에서 확인해볼 질문 5개

출시 전에 아래 질문에 명확히 답이 나오지 않으면, 모델을 바꾸기 전에 “기준”이 먼저입니다.

- 우리 서비스에서 절대 실패하면 안 되는 시나리오는 뭔가?

- 리스크가 발생했을 때 책임 주체와 대응 프로세스가 정해져 있나?

- 평가 항목이 서비스 목적에 맞게 특화되어 있나?

- 통과/실패 기준이 측정 가능하게 정의되어 있나?

- GO / NO-GO 의사결정이 누가, 어떤 근거로 내려지나?

이 질문에 답을 적는 것만으로도, 평가 체계의 구멍이 바로 보일 겁니다.