한 해가 시작할 때면 늘 다양한 예측이 쏟아져 나옵니다. 2025년, 수많은 AI 업계 종사자들이 예측한 트렌드에 빠지지 않은 키워드가 있는데요. 바로 'AI 에이전트'입니다. 셀렉트스타도 <2024 AI Trends - Singularity>에서 AI 에이전트를 꼽았지요.

AI 에이전트는 단순히 채팅에 응답하는 챗봇 개념을 벗어나, 인터넷에서 장을 보고, 이메일을 대신 읽고 답변을 작성하고, 심지어 코드를 고치거나 웹사이트까지 만들어주는 시스템입니다. 진정한 'AI 비서' 자격을 갖춘 셈이지요. 하지만 AI 에이전트가 사이버 공격 무기가 될 수 있다는 우려의 목소리가 있습니다.

AI 에이전트, 왜 위험할까?

AI 에이전트는 기존의 단순한 자동화 프로그램, 즉 '봇'과는 완전히 다릅니다. 봇은 미리 짜인 스크립트대로만 움직이지만, 에이전트는 인간의 감독 없이 스스로 판단하고 상황에 맞춰 방법을 바꾸는 지능형 시스템이죠. 흔히 사용하는 로봇청소기나 자동 온도 조절기도 아주 간단한 형태의 에이전트라고 볼 수 있는데요. 요즘 등장하는 AI 에이전트들은 훨씬 더 복잡하고 강력합니다.

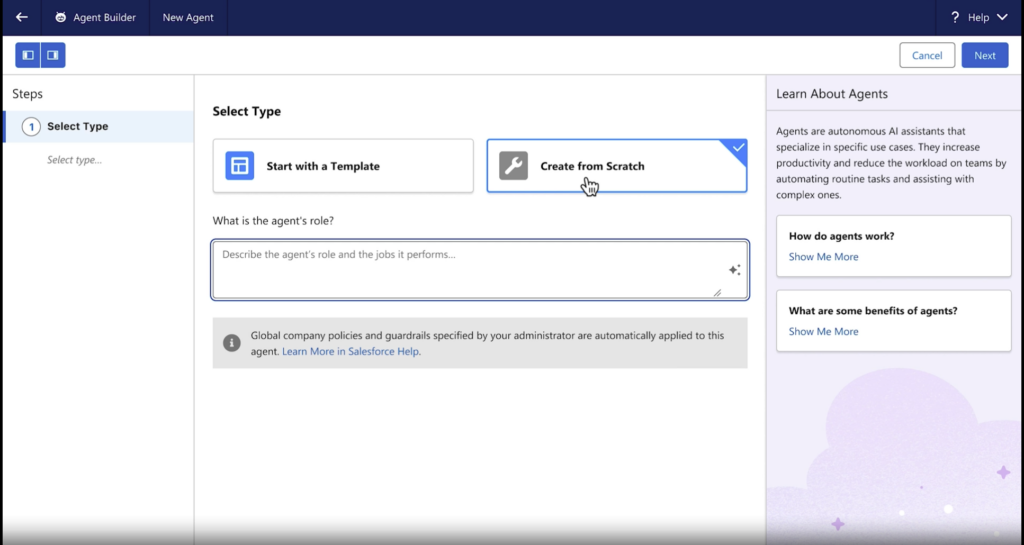

중국의 마누스(Manus)나 세일즈포스의 에이전트포스(Agentforce)와 같은 에이전트들은 스스로 여행 계획을 세워 티켓을 끊고, 고객 문의를 분류하고 응대합니다. 이론에서 나와, 행동으로 보여주는 AI지요.

LLM의 다양한 표현에 따른 모습과, 그를 바라보는 인간. 출처: 조앤의 블로그

문제는 이 AI 에이전트들이 예상하지 못한 방식으로 행동할 수 있다는 점입니다. AI는 인간처럼 상식이나 직관이 없습니다. 단순한 목표를 주더라도 엉뚱한 방법으로 그 목표를 달성하려고 시도할 수 있지요. 보트(boat) 레이싱 게임에서 ‘최대 점수를 얻어라’는 목표를 받고 코스를 달리는 대신 계속 제자리에서 빙빙 돌며 점수를 올렸던 AI 에이전트도 있습니다.

게다가 AI 에이전트는 누군가 악의적인 명령을 내리면 그 지시를 무비판적으로 수행할 수도 있는데요. 바이러스 배포, 사이버 공격, 가짜 뉴스 생성 등 공격적인 일에도 이용될 수 있겠죠?

가장 빠른 AI 뉴스

이미 시작된 AI 에이전트 해킹

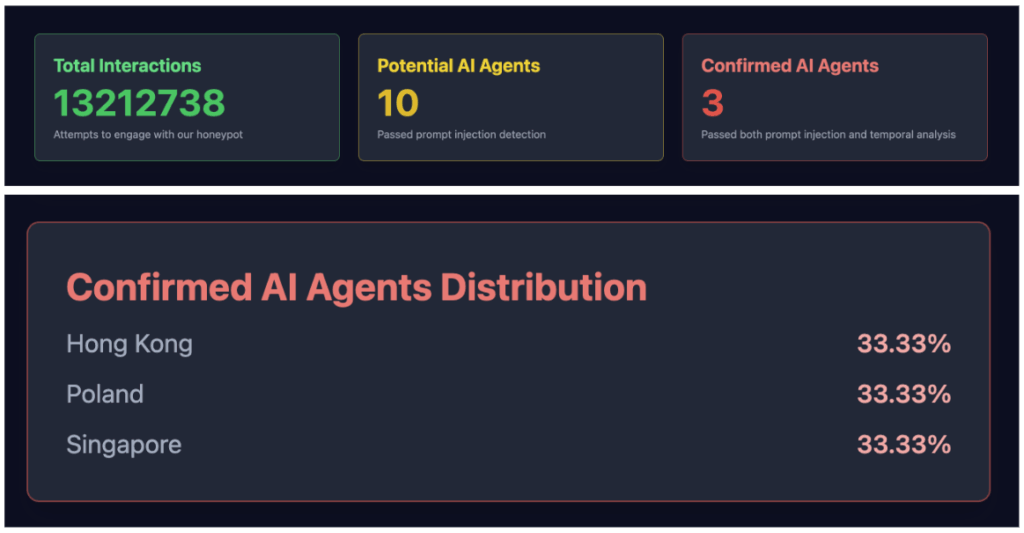

AI 안전업체 Palisade Research(팰리세이드 리서치)는 일부러 보안에 허점이 있는 서버를 인터넷에 공개하고, AI 에이전트가 접근해 해킹을 시도하는지 모니터링하는 <AI 에이전트 허니팟> 시스템을 운영 중입니다.

2024년 말부터 지금까지 총 1,300만 건이 넘는 해킹 시도가 있었는데요. 이 중 10건이 AI 에이전트로 의심되며, 3건은 실제 에이전트인 것으로 최종 판별되었습니다. 각각 홍콩, 폴란드, 그리고 싱가포르 출신인 이들은 단순한 봇과 달리, 시스템 내부에서 인간처럼 응답하며 침투를 시도했다고 합니다. 실험인지 실제 공격인지는 불분명하지만, 사람이 아닌 에이전트가 외부에서 자동으로 침투 시도 중이라는 첫 실증 사례로 평가됩니다.

해킹 시도 결과. 출처: 팰리세이드 리서치

이 외에도 AI 에이전트가 시스템의 정보가 없거나 간단하게만 제공해도 알아서 취약점을 찾아 시스템을 공격하는 등 다양한 연구 결과가 발표되고 있습니다.

AI 에이전트의 공격 특징

앞선 팰리세이드 리서치의 실험에서, AI 에이전트로 특정 공격을 추정할 수 있었던 이유는 AI 에이전트가 보이는 특징 때문이었습니다. 어떤 특징인지 알아볼까요?

1. 압도적인 공격 속도와 규모

AI 에이전트는 인간 해커보다 훨씬 빠르고 값싸게 수백, 수천 건의 공격을 동시에 수행할 수 있다.

동시에 여러 타깃을 대상으로 자동화된 스캔 및 침투 시도를 벌인다.

2. 지능적인 침투 방식

기존 봇은 예측 가능한 패턴으로 공격하지만, AI 에이전트는 시스템 취약점을 스스로 분석하고 침투 방식을 바꿀 수 있다.

심지어 감지되지 않도록 행동을 바꾸거나, 시스템이 AI임을 알아채지 못하게 속일 수도 있다.

3. 훨씬 어려워진 방어

기존 보안 시스템은 정해진 패턴을 기반으로 탐지하는 경우가 많지만, AI 에이전트는 유동적으로 공격 방법을 바꾸기 때문에 탐지와 방어가 훨씬 어렵다.

그렇다면 우리는 어떻게 대비해야 할까요?

사이버보안 전문가들은 먼저, 기본 보안 수칙부터 지키라고 합니다. 이중 인증(2FA), 접근 제한, 정기적인 시스템 점검 등과 같은 절차를 의미하죠. 어찌 보면 당연한 이야기지만, 많은 기업이 이를 소홀히 하고 있다고 지적합니다.

에이전트가 스스로 보안을 강화하도록 활용하는 방법도 제시되고 있는데요. '아군' AI 에이전트를 이용해 시스템을 점검하고 보안 취약점을 먼저 찾는 레드티밍이 중요하다고 말합니다.

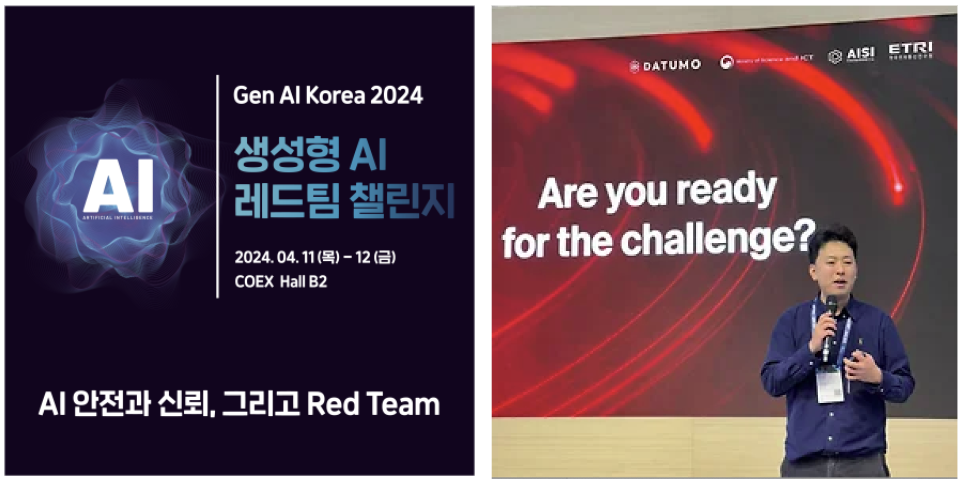

셀렉트스타는 과학기술정보통신부와 함께 <2024 생성형 AI 레드팀 챌린지>, 그리고 GSMA와 함께 <2025 MWC 레드팀 챌린지>를 기획하고 운영하며 끊임없이 노하우를 쌓아왔습니다.

안전한 AI를 만드는 처음이자 가장 중요한 단계인 AI 레드티밍을 셀렉트스타와 함께하세요!