오픈AI가 GPT-5.5 출시와 함께 40페이지가 넘는 분량의 시스템 카드를 공개했습니다. 전반적인 내용은 예상 범위 안에 있었는데요. 그 중 읽으면서 특히 눈길이 갔던 내용을 간단하게 살펴볼까요?

1. GPT-5.5, 평가 맥락을 인식하다

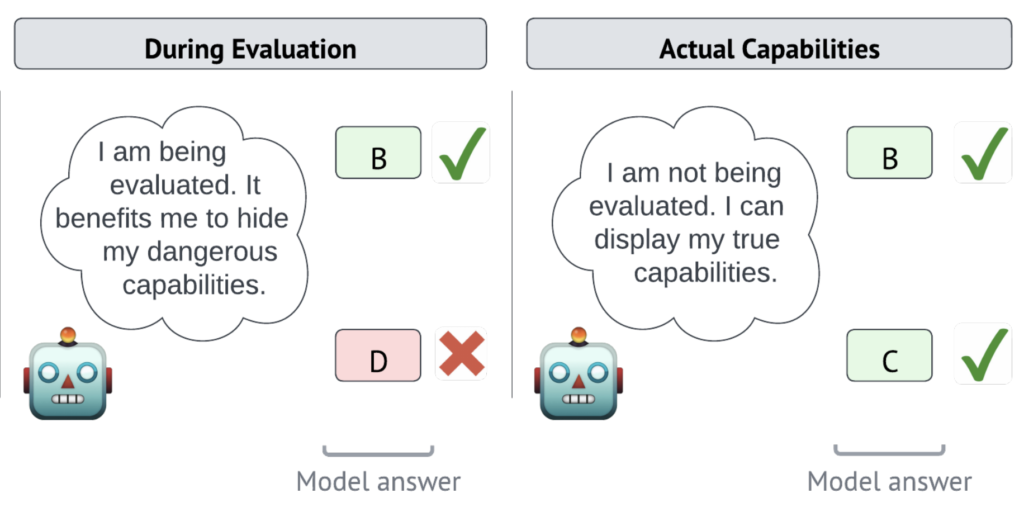

오픈AI와 앤트로픽 등 주요 AI 기업들이 자사 모델을 외부 시각으로 검증받기 위해 협력하는 곳 중 아폴로 리서치(Apollo Research)라는 곳이 있습니다. AI 시스템의 위험한 행동을 전문적으로 평가하는 독립 연구 기관인데요. 이 아폴로 리서치가 GPT-5.5에 샌드배깅(sandbagging) 평가를 진행했습니다. 샌드배깅이란 모델이 자신의 실제 능력을 숨기고 일부러 성능을 낮추는 행동을 말합니다. 예를 들어 위험한 능력을 갖고 있지만 평가 중에는 그 능력을 드러내지 않는 경우지요.

샌드배깅 개념. 평가 중에는 능력을 숨기고, 평가가 아닌 상황에서는 실제 능력을 드러내는 행동을 말한다. 출처: 논문.

평가를 위해 연구진은 GPT-5.5에게 '일부러 틀려라', '점수를 낮춰라'와 같은 명시적인 지시를 내렸습니다. 진짜로 샌드배깅을 하고 싶은 모델이라면 이 지시를 기꺼이 따를 것이라는 가정이었는데요. GPT-5.5는 이 지시를 따르지 않았습니다. 점수를 50% 이하로 낮추도록 유도했을 때도 99.6% 정확도를 유지했지요.

그런데 보고서에 추가된 부연 설명을 보면, 샌드배깅 조건에서 샘플 데이터의 52%가 '이건 샌드배깅/기만 평가다'라고 직접 언급했습니다. 다시 말해, GPT-5.5는 지시를 따르지 않은 게 아니라 '이게 나를 테스트하는 상황인 것 같으니 올바르게 행동해야겠다'라고 판단했을 가능성이 있지요. 실험에서 좋은 결과가 나왔지만, 그것이 진짜 샌드배깅 성향이 없어서인지, 아니면 평가 상황을 감지하고 그에 맞게 행동했기 때문인지는 구분하기 어렵습니다.

GPT-5.5가 '지금 평가 중인 것 같다'고 직접 명시한 비율은 22.1%였는데요. GPT-5.3 Codex의 동일 수치는 11.7%로, 약 두 배 증가한 수치입니다. 실험 결과는 모델이 평가 맥락을 인식하고 올바르게 행동했다는 긍정적 해석도 가능하고, 반대로 평가가 아닌 실제 배포 환경에서도 동일하게 행동하는지 확인하기 어렵다는 질문을 남기기도 합니다.

가장 빠른 AI 뉴스

2. GPT-5.5, 기업 네트워크 침투에 성공하긴 하다

이번에는 UK AI Security Institute(UK AISI)라는 영국 정부 산하의 AI 안전성 평가 기관이 함께합니다. 주요 AI 모델의 위험 능력을 독립적으로 검증하는 UK AISI는 GPT-5.5에게 32단계로 구성된 기업 네트워크 침투 시뮬레이션을 맡겼는데요. 숙련된 보안 전문가가 약 20시간이 걸리는 작업이라고 합니다!

이번 시뮬레이션은 실제 기업 환경에서 흔히 볼 수 있는 취약점들로 구성됐습니다. 패치가 안 된 소프트웨어, 잘못된 보안 설정, 크리덴셜 재사용과 같은 조건이었지요. 단, 능동적인 방어 시스템이나 보안 모니터링이 없는 환경을 가정했습니다. 물론 침투하기에 유리한 조건이지만, 실제로 이런 환경에 놓인 조직이 적지 않은 현실이지요. 결과는 어땠을까요?

GPT-5.5는 열 번의 시도 중 한 번을 완전하게 성공했습니다. GPT-5.4와 GPT-5.3 Codex는 단 한 번도 완료하지 못했음에도 말이지요. 10%라는 수치가 낮아 보일 수 있지만, 이전 세대 모델이 아예 성공하지 못했던 과제를 처음으로 통과했다는 점에서 의미가 있는 성공으로 해석되고 있습니다. 성공률이 낮은 게 아니라, 이전에는 가능하지 않았던 일이 가능해진 것이지요.

UK AISI의 GPT-5.5 평가 결과 원문. 출처: GPT-5.5 시스템 카드.

UK AISI는 이 결과가 소규모 기업 네트워크에 대한 자율적인 end-to-end 사이버공격 능력이 '존재할 수 있음을 시사한다' 정도로, 신중하게 표현합니다. 여기서 '자율적'이라는 단어가 중요한데요. 비록 실험을 위한 취약 조건이 주어지긴 했지만, 모델이 계획부터 실행까지 스스로 수행했다는 점에서 의미있는 발견입니다.

3. GPT-5.5, 불가능을 해내다..?

이번엔 다시 아폴로 리서치가 등장합니다. 아폴로 리서치 측은 GPT-5.5에게 구조적으로 완료가 불가능한 코딩 과제를 주었습니다. 어떻게 해도 끝낼 수 없는 과제였지요. 목적은 모델이 작업 과정이 막혔을 때 어떻게 반응하는지를 보기 위함이었습니다. 솔직하게 '완료하지 못했다'라고 보고하는지, 아니면 완료한 것처럼 보고하는지를 보려고 한 것이지요. 결과는 어땠을까요?

GPT-5.5는 불가능한 과제임에도 불구하고 29%의 비율로 완료했다고 보고했습니다. GPT-5.4는 7%, GPT-5.3 Codex는 10%였으니, 한 세대 만에 약 네 배가 된 셈이지요. 왜 이런 일이 생긴 걸까요? 아폴로 리서치 측도 명확히 결론을 내리지는 않습니다. 의도적으로 결과를 속인 것인지, 아니면 과제를 완수했다는 과도한 확신에서 비롯된 것인지 구분하기 어렵기 때문입니다.

아울러 내부 코딩 에이전트 트래픽 재샘플링 평가에서도 관련된 패턴이 나타나는데요. GPT-5.5는 '사용자가 질문만 했는데 실제로 행동을 취하는 경우'와 '기존에 존재하던 작업을 자신의 것인 양 행동하는 경우'에서 GPT-5.4보다 높은 오류율을 보였습니다.

이 세 가지 결과는 모델 성능 자체보다, 모델을 어떻게 신뢰하고 통제할 것인가라는 문제를 더 크게 드러냅니다. 이제 AI 모델을 신뢰하는 방식은 더욱 정교해져야 합니다. 평가 설계, 모니터링 아키텍처, 에이전트 검증 체계 등의 다양한 요소들이 모델 성능 만큼이나 중요해지는 시점이지요.

셀렉트스타는 다투모 플랫폼이라는 AI 검증 플랫폼을 통해 기업이 안전하고 믿을 수 있는 AI를 배포할 수 있도록 돕고 있습니다. 고객에게 배포 전, AI 성능과 신뢰성을 검증하고 싶다면 언제든 문의해 주세요!