최근 The New Yorker는 샘 올트먼과 OpenAI를 둘러싼 매우 긴 탐사보도를 내놓았습니다. 제목부터 강합니다.

"Sam Altman May Control Our Future—Can He Be Trusted?"

직역하면 "샘 올트먼이 우리의 미래를 통제하게 될지도 모른다. 그를 믿을 수 있는가?" 정도일텐데요. AGI 혹은 그에 준하는 강력한 AI 시스템을 만들고 배치하는 과정에서, 샘 올트먼이라는 인물은 그 권력을 맡길 만큼 신뢰할 수 있는 리더일까요?

기자는 다음 다섯 가지에 대해 이야기합니다:

- OpenAI의 비영리적 창립 철학이 어떻게 무너졌는가

- AI 안전 담론이 제품 출시와 매출 논리에 어떻게 밀렸는가

- 창업자형 리더십과 이사회 거버넌스가 어떻게 충돌했는가

- 초거대 AI 산업이 자본시장, 군사, 국가권력과 어떻게 결합하고 있는가

- 그리고 그 중심에서 샘 올트먼이 어떤 방식으로 권력을 행사해왔는가

기자가 펼치는 주장과 논리를 차근차근 알아볼까요?

1. OpenAI의 창립 철학, 어떻게 무너졌는가

2015년 12월 11일에 올라온 OpenAI 블로그 글. 출처: OpenAI.

2. AI 안전 담론이 어떻게 밀렸는가

OpenAI가 겉으로는 계속해서 안전을 말해왔지만, 실제 조직 운영에서는 점점 더 제품 출시와 상업화, 성장 속도가 우선되었다고 기자는 말합니다. 샘 올트먼 역시 AGI의 위험성과 정렬 문제, 규제 필요성을 여러 차례 언급해왔고, OpenAI도 오랫동안 '안전을 중시하는 AI 회사'라는 이미지를 가져왔는데요. 기자는 바로 그 이미지와 실제 우선순위 사이의 간극을 문제 삼습니다.

기사에 따르면, 내부에서는 점차 안전 논의가 실제 의사결정의 중심에서 밀려났다는 불만이 쌓여갔습니다. 대표적으로 superalignment 팀에는 중요한 자원을 투입하겠다고 했지만, 실제로는 약속된 수준의 연산 자원이 배정되지 않았고, 더 좋은 자원은 수익성과 제품 경쟁력에 가까운 쪽으로 갔다는 증언이 등장합니다. 결국 안전은 계속 언급되었지만, 조직의 중심축은 점점 더 출시 속도, 시장 우위, 매출 기회 쪽으로 이동했다는 것이지요.

이는 단순한 예산 배분 문제가 아닙니다. 중요도가 높은 곳에 가장 좋은 자원을 배정한다는 점에서, OpenAI의 실제 우선순위가 드러났다는 주장입니다. 그 결과, 안전은 OpenAI의 정체성을 설명하는 언어로는 남아 있었지만, 실제 운영에서는 점점 더 뒤로 밀려났다는 것이 기자의 해석입니다.

3. 리더십과 이사회가 어떻게 충돌했는가

뉴요커는 2023년 11월의 샘 올트먼 해임 사태를 단순한 인사 문제가 아니라, 창업자형 리더십과 이사회 거버넌스가 정면으로 충돌한 사건으로 해석합니다. OpenAI의 이사회는 원래부터 창업자나 경영진을 견제하기 위해 존재하는 구조였고, 필요하다면 회사의 성장보다도 안전과 공익을 우선할 수 있어야 했습니다. 다시 말해, OpenAI는 처음부터 창업자의 권력 자체를 제어할 장치가 있어야 한다는 문제의식 위에 세워진 조직이었지요.

하지만 기사에 따르면, 실제 위기 상황에서 그 구조는 제대로 작동하지 않았습니다. 이사회가 올트먼을 해임하자 마이크로소프트를 비롯한 투자자들이 강하게 반응했고, 직원 대다수가 올트먼 복귀를 요구했으며, 실리콘밸리의 인맥과 네트워크도 빠르게 움직였지요. 결국 올트먼은 며칠 만에 복귀했고, 그를 해임하는 데 관여한 이사들은 대부분 물러났습니다.

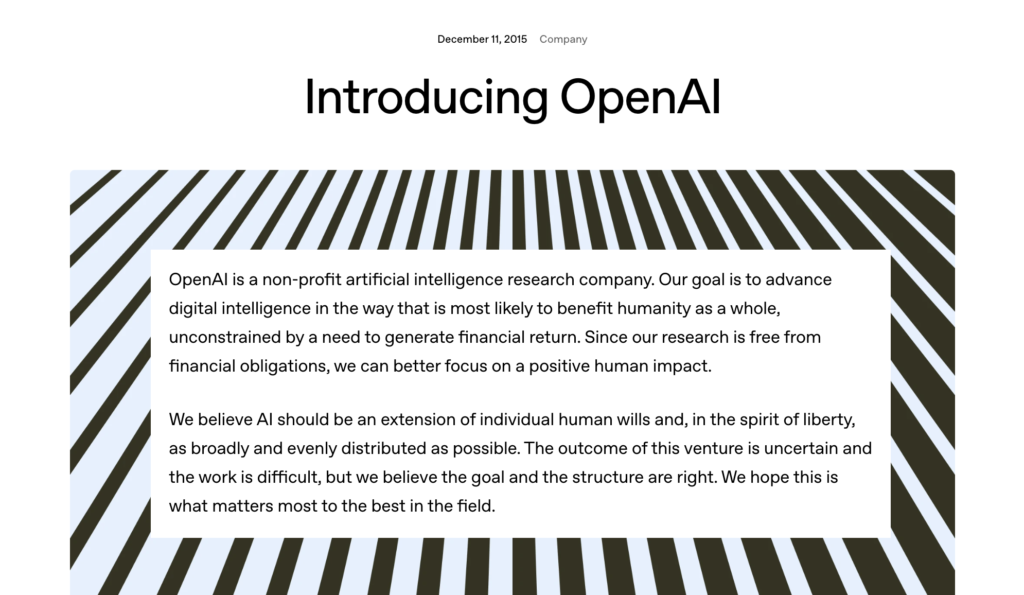

올트먼이 OpenAI 출입을 위해 게스트 배지를 받은 사진. 출처: 샘 올트먼의 X.

기자는 OpenAI가 원래 창업자를 견제하기 위해 특수한 거버넌스를 만든 조직이었지만, 실제로는 그 구조가 창업자의 권력과 생태계 네트워크를 이기지 못했다는 점을 지적합니다. 오히려 해임 사태 이후 샘 올트먼의 입지는 더 강해졌고, 뉴요커는 이를 OpenAI 거버넌스의 결정적 실패로 보고 있습니다.

가장 빠른 AI 뉴스

4. AI 산업이 국가권력과 어떻게 결합하는가

이제 시야는 OpenAI 내부를 넘어, 초거대 AI 산업 전체로 넓어지는데요. 기자는 이제 AI 기업이 단순한 기술 기업이 아니라, 막대한 자본과 인프라, 국가권력과 안보 논리까지 함께 움직이는 존재가 되었다고 봅니다. 오늘날 최첨단 AI를 개발하려면 뛰어난 연구자만이 아니라, 데이터센터, 반도체, 전력, 클라우드, 글로벌 자금이 함께 필요하기 때문이지요.

기자는 특히 OpenAI의 중동 자본 및 인프라 구상에 주목합니다. 사우디와 UAE 같은 국가 및 권력자들과의 접촉, 초대형 데이터센터와 칩 생산 인프라를 둘러싼 구상은 AI 산업이 얼마나 빠르게 지정학적 산업이 되어가고 있는지를 보여주기 때문이지요. 기자는 이 기술의 핵심 인프라가 누구의 돈으로, 누구의 통제 아래, 어떤 국가적 이해관계 속에서 운영될 것인가라는 질문을 던집니다.

OpenAI가 UAE 메가 AI 허브를 론칭했다는 뉴스. 출처: TECHJUICE.

또 다른 축은 군사와 국방인데요. 기사에 따르면 OpenAI를 비롯한 주요 AI 기업들은 점점 더 국가안보, 군사 활용, 전략 기술 경쟁의 논리 속으로 들어가고 있습니다. 뉴요커는 이를 통해, AI 산업이 더 이상 '모두를 위한 기술 혁신'이라는 말만으로 설명되지 않으며, 이미 자본시장과 국가 경쟁, 군사적 이해관계가 결합한 권력 구조 속에서 움직이고 있다고 주장합니다.

5. 올트먼은 어떻게 권력을 행사해왔는가

결국 뉴요커가 가장 강하게 문제 삼는 것은 샘 올트먼의 권력 행사 방식입니다. 기사 속 올트먼은 단순한 CEO라기보다, 서로 다른 이해관계자에게 각기 다른 언어로 같은 프로젝트를 정당화할 수 있는 인물로 그려집니다. 엔지니어에게는 사명과 안전을, 투자자에게는 성장과 기회를, 정책가에게는 책임과 규제를, 그리고 국가에는 전략적 필요를 말하면서 모두를 자기 쪽으로 끌어당길 수 있지요. 기자는 올트먼의 핵심 역량은 기술 전문성 자체보다도 설득과 조정, 그리고 서사 설계 능력에 있다고 주장합니다. 각 집단이 듣고 싶어 하는 말을 매우 효과적으로 제시하고, 그 과정에서 자본과 인재, 정치적 정당성을 동시에 확보해왔다고 말하지요.

문제는 이런 능력이 OpenAI 같은 조직에서는 견제를 무력화하는 힘으로 작동할 수 있다는 점입니다. 뉴요커는 샘 올트먼이 비영리 구조와 안전 담론, 규제 언어를 자신의 정당성을 강화하는 데 활용해왔고, 이사회 같은 견제 장치 역시 결정적인 순간에는 우회하거나 재배열해왔다고 보고 있는데요. 기사 속 샘 올트먼은 그저 호불호가 갈리는 경영자가 아니라, AGI 시대의 자본과 기술, 국가권력을 한 방향으로 묶어낼 수 있는 매우 강력한 권력형 인물로 묘사됩니다. 바로 그 점 때문에 뉴요커는 그를 더욱 경계해야 한다고 주장합니다.

샘 올트먼. 출처: The Atlantic.

뉴요커는 샘 올트먼을 매우 강한 어조로 비판합니다. 기사에 따르면, OpenAI 공동창업자이자 당시 수석 과학자였던 일리야 수츠케버는 OpenAI가 점점 더 위험하고 강력한 기술에 다가가고 있다고 보면서, 올트먼이 AGI 같은 기술의 결정권을 맡길 만큼 신뢰할 수 있는 인물은 아니라고 판단했습니다. 또 수츠케버가 이사회에 보낸 비밀 메모 가운데는 올트먼의 문제적 행동을 항목별로 정리한 내용이 있었는데, 뉴요커는 그 첫 번째 항목이 ‘Lying’이었다고 전합니다.

우리는 샘 올트먼 개인에 대한 호불호를 넘어, AGI 시대의 막대한 권력을 누구에게 맡길 수 있는지 함께 고민해야 합니다. 물론 이런 고민만으로 문제가 해결되지는 않겠지요. 그럼에도 적어도 무엇이 바람직한 방향인지, 무엇이 위험한 신호인지 계속 살피고 이야기해야 합니다. 더 안전한 미래를 위해 사회와 업계가 함께 기준을 세우고, 필요한 목소리를 내야 합니다.