지난 5월 21일, 유럽연합(EU)이 세계 최초로 마련된 ‘인공지능법안(AI Act)’ 시행을 최종 확정했습니다. 2026년부터 전면 시행 예정인 인공지능법안은 유럽에서 만든 모델이 아니더라도, 유럽에서 사용한다면 따라야 하는 법안인데요. 세계 최초인만큼 앞으로 만들어질 다양한 법안에 지대한 영향을 끼칠 것으로 생각됩니다. 오늘은 이 법안을 한 번 살펴보겠습니다.

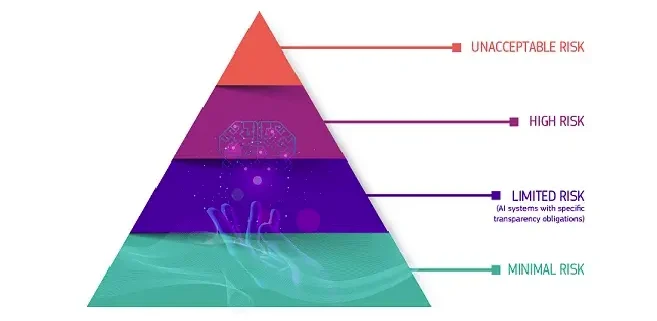

4 Risk Levels of AI

AI Act는 인공지능의 위험 요소를 허용 불가한 위험(Unacceptable risk), 고위험(High risk), 제한된 위험(Limited risk), 최소 위험(Minimal risk), 이렇게 네 개의 단계로 구별합니다. 각 단계는 연루된 데이터의 민감도와 적용된 모델의 목적을 기준으로 나뉘는데요.

출처: Shaping Europe's digital future AI Act

허용이 되는 범위이지만, 고위험 군에 속하는 AI는 아래와 같은 분야에서 사용된다고 정의합니다:

중요 인프라 – 생명과 건강을 위협할 수 있는 교통 문제 등

교육 또는 직업 훈련 – 교육 및 직업 경로에 접근하는 것을 결정할 수 있는 행위 등

제품의 안전 구성 요소 – 로봇 보조 수술에서의 AI 애플리케이션 등

고용, 노동자 관리 및 자영업 접근 – 채용 절차에 영향을 미치는 이력서 정렬 소프트웨어 등

필수적인 민간 및 공공 서비스 – 대출을 받을 기회를 박탈하는 신용 점수 평가 등

법 집행 – 기본권을 침해할 수 있는 증거 신뢰도 평가 등

이주, 망명 및 국경 관리 – 비자 신청 자동 검토 등

사법 및 민주적 절차의 관리 – 법원 판결 검색을 위한 AI 솔루션 등

그렇다면 제한된 위험은 어떤 걸까요?

제한된 위험은 AI 사용이 투명하지 않아서 발생하는 위험을 의미합니다. AI와 상대하고 있거나 AI가 생성한 콘텐츠라면 반드시 투명하게 공개를 해야한다고 명시하죠. 딥페이크와 관련된 오디오, 비디오도 예외 없습니다.

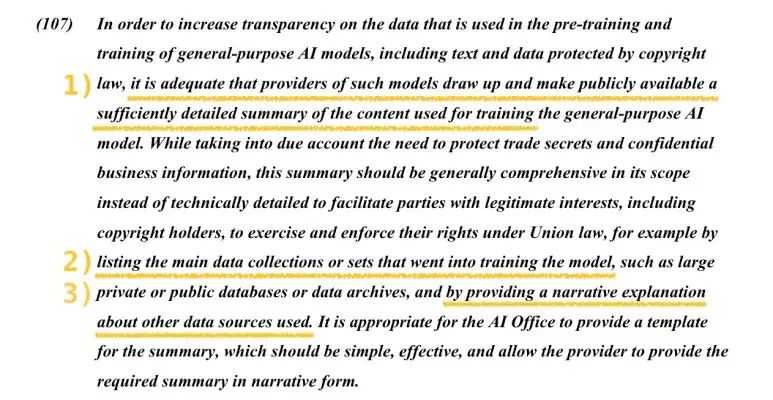

General Purpose AI

특정 업무를 수행하기 위해 튜닝된 AI가 아닌, 전반적인 업무 수행이 가능한 General purpose AI 예시로는 애플의 Siri나 아마존의 Alexa가 있습니다. 이런 범용 AI도 이제는 더욱 ‘투명’해져야 한다는데요. 범용 AI 모델 제공자가 지켜야 할 수칙을 나열한 107번 조항을 함께 보겠습니다.

출처: AI Act 법안

1) 모델 제공자는 학습에 사용된 콘텐츠에 대해 충분히 상세한 요약을 공개하는 것이 적절하다.

2) 모델 학습에 사용된 주요 데이터셋을 나열한다.

3. 그 외 사용된 데이터 출처에 대한 설명을 제공한다.

이번 법안은 데이터 출처 공개를 중요하게 여깁니다. 세계 최초 AI 규제인만큼 앞으로 생길 다양한 AI 규제에 큰 영향을 미칠 것으로 보이는데요. 앞으로는 전세계적으로 AI 모델 학습에 사용된 데이터에 대한 상세한 정보가 더욱 엄격하게 요구되지 않을까요? 🤔

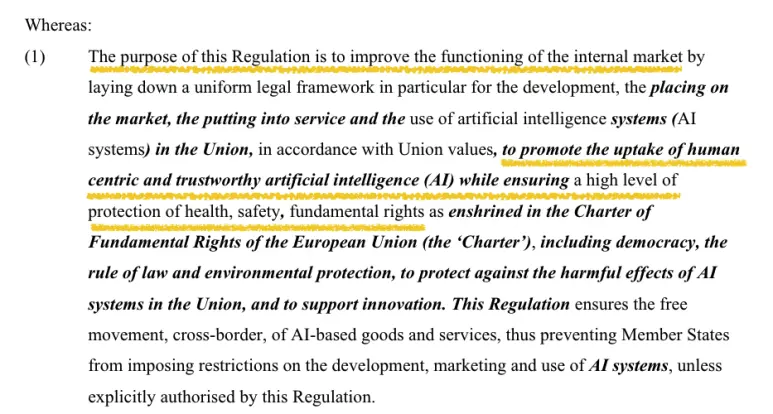

Human-centric AI

AI Act의 목적은 정확히 무엇일까요?

출처: AI Act 법안

AI Act는 그 목적을 “to promote the uptake of human-centric and trustworthy AI”, 즉 ‘인간 중심의 믿을 수 있는 AI를 활용화를 촉진하기 위해’로 서술합니다. 여기서 눈에 띄는 표현이 있는데요. 바로 Human-centric AI 입니다.

이번 법안에서는 transparent(투명한)와 non-discriminatory(차별하지 않는)가 자주 등장합니다. 인간이 신뢰할 수 있는 human-centric AI란 결국 투명하고, 차별이 없어야 하기 때문인데요.

모델의 정확성을 위해서는 data-centric AI가,

안전성을 위해서는 human-centric AI가 필요합니다.

The Data for Smarter AI 라는 모토 아래 셀렉트스타는 오직 고품질 데이터만을 제공해 왔습니다. 또한, 안전한 AI에 대한 사명감을 갖고 레드팀 챌린지를 기획하고 운영하기도 했습니다. 그 어떤 규제가 생겨도 투명하게 데이터 출처를 밝힐 수 있는, 라이선스가 확보된 데이터로 안심하고 AI 모델을 구축하실 수 있도록 도와드리겠습니다. 😌